O desenvolvimento da Inteligência Artificial tornou-se um dos maiores vetores de transformação da sociedade contemporânea. Contudo, a velocidade dessa mudança impõe um risco: permitir que os algoritmos avancem mais rápido do que os princípios que deveriam regulá-los.

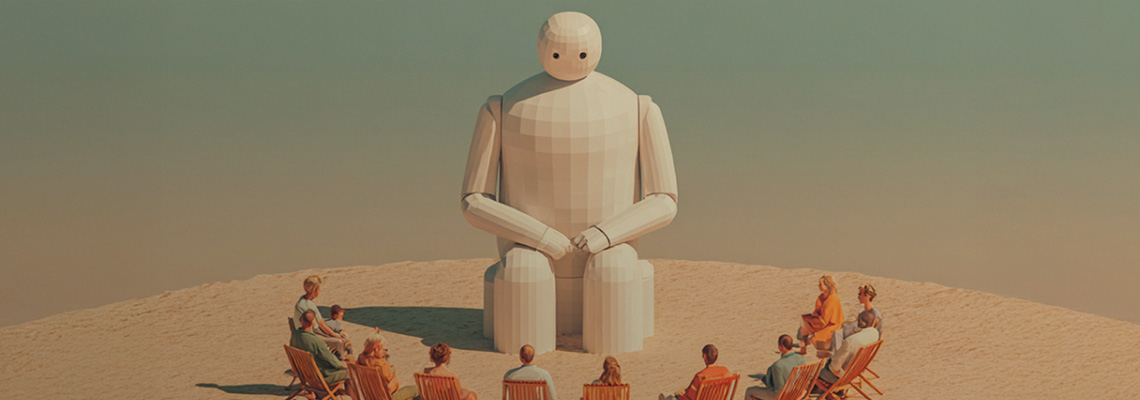

Em meio a esse cenário, ganha força a ideia de que a tecnologia precisa ser guiada não apenas pela eficiência técnica, mas por visões de futuro que priorizem o bem comum. É nesse ponto que a utopia — aqui, aplicada no sentido de sociedade ideal, e não no senso comum de “devaneio” — assume um papel decisivo como modelo de orientação ética e política da inovação tecnológica.

No contexto deste artigo, utopia deve ser entendida como “projeto de responsabilidade coletiva”, capaz de articular avanços tecnológicos com pilares axiológicos, como equidade, sustentabilidade e dignidade humana. Esse mesmo conceito pode — e deve — ser aplicado à IA: pensar tecnologicamente o futuro exige imaginar cenários desejáveis e viáveis, e não apenas calcular probabilidades ou desenvolver novas funcionalidades.

IA responsável: entre a imaginação ética e a regulação concreta

A utopia aplicada à IA não se refere a sonhos inalcançáveis. Trata-se da capacidade de projetar usos desejáveis da tecnologia e de estabelecer salvaguardas éticas para sua implementação.

Organizações internacionais reconhecem essa urgência. A UNESCO, por exemplo, aprovou, em 2021, a Recomendação sobre a Ética da Inteligência Artificial, que estabelece parâmetros normativos como transparência, governança humana, responsabilidade e proteção de dados. A recomendação foi aprovada por 193 países e representa um esforço global para alinhar a IA aos direitos humanos e à diversidade cultural.

Caminho semelhante traçou a União Europeia, ao aprovar, em 2024, o AI Act: primeiro regulamento abrangente da história sobre Inteligência Artificial. A norma propõe a classificação dos sistemas de IA por grau de risco, com exigências específicas de auditoria, rastreabilidade e documentação para usos considerados críticos, como reconhecimento facial em espaços públicos ou algoritmos de decisão em justiça criminal.

Trata-se, portanto, de uma tentativa concreta de evitar que a promessa tecnológica se torne uma ameaça à liberdade, à privacidade ou à autonomia, imprescindíveis para impedir o que Yuval Harari, em seu livro 21 lições para o Século 21, chamou de “ditaduras digitais” — regimes em que o poder dos algoritmos se sobrepõe às liberdades civis.

Ética informacional e engenharia de valores

A aplicação prática da utopia na IA exige incorporar fundamentos humanísticos desde a concepção dos sistemas, garantindo que as decisões automatizadas reflitam valores éticos baseados no primado da responsabilidade coletiva. Como observa Luciano Floridi, um dos principais filósofos contemporâneos da informação, é necessário criar uma “infosfera ética” — um ambiente informacional no qual a tecnologia opere segundo parâmetros morais análogos àqueles que orientam as instituições humanas. Com isso, a Inteligência Artificial não se limita a mero recurso técnico de otimização, mas uma extensão das capacidades humanas comprometida com a justiça, a liberdade e a dignidade – com a ‘utopia’, portanto.

Entretanto, isso não é uma tarefa fácil.

Traduzir direitos humanos em requisitos técnicos verificáveis, significa evitar que os sistemas reproduzam — ou amplifiquem — vieses históricos, discriminações estruturais ou assimetrias de poder invisíveis, muitas vezes embutidas nos dados ou nos critérios utilizados para treinar os algoritmos.

Por isso, é preciso haver uma abordagem da IA centrada no ser humano que estabeleça diretrizes claras para que os sistemas inteligentes sejam justos, explicáveis, seguros, inclusivos, além de exigir que estejam sob supervisão humana contínua. Não se trata apenas de adicionar uma “camada ética” após o desenvolvimento, mas de reestruturar todo o processo de criação tecnológica com base em valores fundamentais. O objetivo é assegurar que a IA atue como instrumento de promoção de direitos, e não como ameaça ao tecido democrático ou à equidade social.

Como se pode deduzir, na prática, isso exige repensar profundamente a engenharia de software e a arquitetura algorítmica, integrando dimensões éticas desde as fases iniciais do ciclo de vida dos sistemas. Entre as ações prioritárias, destacam-se:

- Avaliação de impacto algorítmico antes da implantação de sistemas automatizados, especialmente em setores sensíveis como a saúde, a justiça, a educação e as finanças. Essas avaliações devem identificar potenciais riscos à privacidade, à igualdade de tratamento e ao acesso justo a direitos, permitindo, previamente, a aplicação de estratégias de mitigação;

- Participação social na definição dos critérios de justiça e eficiência utilizados por algoritmos, com foco na escuta de grupos vulneráveis, comunidades afetadas e especialistas em direitos humanos – por meio de consultas e audiências públicas, por exemplo. Esse engajamento democrático amplia a legitimidade e a aderência social das soluções tecnológicas, evitando a imposição silenciosa de racionalidades técnicas sobre realidades diversas;

- Implementação de mecanismos de explicabilidade e contestação, que garantam que os indivíduos afetados por decisões automatizadas possam: i) compreender os fundamentos dessas decisões; ii) solicitar revisão humana; e iii) exercer seus direitos. Isso é particularmente relevante em sistemas preditivos que influenciam crédito, seguros, diagnósticos clínicos e ações judiciais, onde a opacidade algorítmica pode comprometer a autonomia e/ou o devido processo legal;

- Adoção de princípios de design inclusivo e acessível, que levem em conta não apenas as diversidades culturais, linguísticas e cognitivas dos usuários, mas também as condições materiais de acesso à tecnologia. Isso significa desenhar interfaces compreensíveis, compatíveis com dispositivos de baixo custo e capazes de atender pessoas com deficiência ou com baixa alfabetização digital.

Além dessas diretrizes, cresce a adoção de frameworks técnicos como o Ethics by Design, Value-sensitive Design e Human Rights Impact Assessment, que sistematizam o processo de incorporação de valores coletivos ao desenvolvimento tecnológico. Tais abordagens reforçam que a IA ética não é um “extra” desejável, mas uma condição necessária para a legitimidade e a sustentabilidade social da inovação.

Dessa forma, ao aplicar a utopia como lente de projeto – e não como ideal distante – torna-se possível construir sistemas de IA que respeitem a complexidade da vida humana, ampliem liberdades e fortaleçam a cidadania. O desafio contemporâneo é justamente esse: transformar valores em código, direitos em arquitetura, e princípios em prática técnica verificável — colocando a tecnologia a serviço do futuro que se deseja construir coletivamente.

Nesse passo, a Partnership on AI e o Institute for Ethical AI são exemplos de iniciativas colaborativas que visam estabelecer práticas técnicas orientadas por esses valores. Trata-se, portanto, de traduzir a utopia em engenharia, criando sistemas que não apenas funcionem, mas que promovam sociedades mais justas.

Riscos distópicos: a autonomia sob ameaça

Apesar do potencial utópico da IA, a ausência de regulamentação e de princípios compartilhados pode transformar a inovação em instrumento de desumanização. A centralização do poder computacional, a opacidade dos algoritmos e a captura de dados em larga escala colocam em risco a liberdade de escolha e a dignidade humana. Como discutido por Hans Jonas em “O Princípio Responsabilidade”, o desenvolvimento tecnológico exige prever as consequências de longo prazo e agir segundo o imperativo de proteger as condições para a vida humana autêntica.

Os sistemas de IA não são neutros. Quando treinados com dados enviesados ou utilizados sem supervisão crítica, eles amplificam desigualdades estruturais. Em setores como segurança pública, saúde e crédito, algoritmos têm potencial para consolidar decisões injustas com aparência de objetividade. Casos emblemáticos de algoritmos racistas, ferramentas de vigilância massiva ou manipulação de comportamento via plataformas digitais mostram que a IA, se mal direcionada, pode comprometer as bases da democracia e da justiça social.

Esse cenário distópico não deve ser visto como inevitável, mas como um alerta necessário. A utopia, neste ponto, cumpre uma função essencial: lembrar à sociedade o que ela está disposta a aceitar — e o que não está.

A utopia como fundamento para políticas públicas e inovação sustentável

No setor público, a utopia orientada pelo bem comum pode moldar políticas de inovação tecnológica que priorizem o acesso equitativo e a promoção de direitos. Iniciativas como plataformas de IA no controle de políticas públicas, sistemas inteligentes para auditoria de contas e assistentes digitais para melhorar a prestação de serviços podem, quando bem reguladas, melhorar a transparência e a eficiência administrativa. No entanto, é essencial que essas soluções não reproduzam estruturas obscuras de poder algorítmico — o que requer transparência, auditabilidade e accountability institucional.

No setor privado, a incorporação de valores utópicos já é reconhecida como diferencial competitivo. Estudos da McKinsey e do World Economic Forum indicam que empresas que implementam políticas de IA responsável tendem a apresentar maior confiança dos consumidores, menores riscos legais e mais capacidade de adaptação a novas regulamentações.

Por fim, cabe ao Estado — em cooperação com universidades, empresas e sociedade civil — garantir que as diretrizes utópicas não sejam apenas declarações de boas intenções, mas fundamentos concretos para políticas públicas, legislações e programas de fomento à pesquisa e ao desenvolvimento. Assim como a ciência exige método, a utopia, aqui discutida, exige construção política e social.

Considerações finais: imaginar para transformar

A Inteligência Artificial pode ser a tecnologia mais transformadora do século XXI, mas seu potencial só será plenamente realizado se guiado por visões utópicas orientadas por responsabilidade, equidade e humanidade. Novamente, utopia, aqui, não significa sonho ou ingenuidade, mas coragem para projetar e construir o futuro com propósito coletivo e valores universais. Como defendido no artigo anterior, “utopias funcionam como mapas: elas não descrevem o território atual, mas indicam para onde queremos ir”.

Na encruzilhada entre técnica e ética, entre inovação e justiça, cabe aos líderes públicos, engenheiros, pesquisadores e cidadãos assumir a responsabilidade de imaginar o futuro que desejam construir com a IA. Essa imaginação não deve temer o imprevisível, mas trabalhar diligentemente com todas as ferramentas necessárias: dignidade, autonomia, equidade e sustentabilidade.

A tecnologia é uma força poderosa, mas a sua bússola é sempre a vontade humana. E nada guia o caminho de modo mais estratégico — ou transformador — do que uma utopia orientada por valores.