Em dezembro de 2022, alguns meses depois de saber que havia ganhado uma bolsa de estudos da Iowa Arts Fellowship para cursar o programa MFA na Universidade de Iowa, David James “DJ” Savarese participou de uma entrevista televisionada em um canal de notícias local. Mas para responder às perguntas do apresentador, Savarese, um poeta de 30 anos com autismo que usa métodos alternativos de comunicação, precisou criar um truque de comunicação. Alguns desses truques ele usa desde que era uma criança.

Savarese participou remotamente, do sofá de sua sala em Iowa City. “O que motiva você a escrever suas poesias?”, perguntou o âncora do noticiário. Assistindo à entrevista on-line, pude ver Savarese virar brevemente a cabeça para longe da câmera, como se estivesse compondo um pensamento. Ele se inclinou em direção ao seu laptop, um MacBook Pro que também é seu dispositivo de comunicação, e tocou algumas teclas para ativar uma voz sintetizada. “A poesia me oferece uma maneira de responder menos e conversar mais.”

“Em uma época em que o medo domina as ondas sonoras”, continuou ele, “a poesia desperta os sentidos e nos desaloja de uma experiência estritamente baseada em significados, liberando as ideias para se misturarem através das fronteiras do cérebro e nos levando além das construções artificiais e classificatórias de poder”. Ele se balançava e acenava com a cabeça para suas frases, que subiam e desciam como música.

Desviei minha atenção para tentar entender a configuração técnica de Savarese. Não vi nenhum fio ou dispositivo no quadro. Será que ele estava usando um chip cerebral para transmitir seus pensamentos sem fio para um aplicativo de processamento de texto em seu computador? Eu me perguntei: “Será que estou vendo o futuro aqui?”

Para se preparar para uma entrevista no ar, DJ Savarese, um poeta com autismo que usa métodos alternativos de comunicação, digitou respostas a perguntas previamente enviadas em um arquivo do Microsoft Word. Durante a transmissão, ele respondeu ao apresentador usando a função “Ler em voz alta” do Word para falar suas respostas pré-compostas.

Havia um motivo para meu foco específico: na época, eu estava pesquisando a tecnologia de Comunicação Aumentativa e Alternativa (CAA) para minha filha, que tem cinco anos de idade e também não fala. Desanimada com as opções disponíveis – um punhado de aplicativos para iPad que parecem (e funcionam) como se tivessem sido codificados na década de 1990 -, mergulhei no mundo especulativo e mais empolgante das interfaces que conectam cérebro e computador. Será que um chip cerebral poderia permitir que minha filha se expressasse verbalmente com o mesmo esforço mínimo que eu preciso para abrir a boca e falar? Como ela poderia soar ao me contar sobre seu dia na escola? Cantando “Feliz Aniversário” ou dizendo “Mamãe”? Eu queria que o futuro estivesse aqui agora.

Mas observar Savarese revelou um pensamento mágico de minha parte. Por trás da cortina, a mecânica de sua participação era de baixíssima tecnologia – na verdade, era bem ruim.

O processo não se encaixava nos moldes do que eu achava que a tecnologia deveria fazer: tirar o trabalho de uma operação manual e torná-la mais rápida e fácil. A emissora havia convidado Savarese para participar do programa e um produtor o havia enviado as perguntas por e-mail com antecedência. Para se preparar, Savarese passou cerca de 15 minutos digitando suas respostas em um arquivo do Microsoft Word. Quando chegou a hora da entrevista ao vivo, o apresentador recitou as perguntas, às quais Savarese respondeu em seu MacBook usando a função “Ler em voz alta” do Word para falar suas respostas pré-compostas. Os tipos de tecnologia prontamente disponíveis que poderiam alimentar um dispositivo de comunicação assistida — Inteligência Artificial, processamento de linguagem natural, previsão de palavras, banco de voz, rastreamento de olhares — não desempenharam nenhum papel nesse caso. E, no entanto, sem nenhum dos recursos que eu esperava ver, Savarese tinha as ferramentas necessárias para expressar a plenitude de seus pensamentos.

Após seis anos de experiência selvagem e emocionalmente desgastante de criar uma criança com deficiência em um mundo capacitista, aprendi a manter minha mente aberta a todas as possibilidades. Embora minha filha tenha atrasos intelectuais e físicos — ela nasceu sem 130 genes e 10 milhões de pares de bases de DNA —, ela é uma criança saudável, alegre e de opinião forte. Desde que entrou em nossas vidas, sempre me surpreendi com o fato de que coisas simples que facilitariam a vida dela — cortes de cabelo, lápis de cor mais grossos, gentileza — não sejam mais comuns em nossa sociedade avançada. Mas temos uma série de coisas mais sofisticadas e inventivas que eu não imaginava que existiriam — ambientes calmos de realidade virtual incorporados a scanners de ressonância magnética com o tema Frozen, por exemplo. Portanto, espero que faça sentido que, inicialmente, ao assistir Savarese falar, eu tenha presumido que ele estava usando um chip cerebral implantado para transmitir automaticamente seus pensamentos em um documento do Word. Isso me pareceu mais plausível do que revolucionário. Quando percebi que não havia nenhum chip cerebral – apenas alguns e-mails e o Microsoft Word — uma sensação familiar de decepção me trouxe de volta à Terra com um baque.

“Tudo se move lentamente porque precisa ser compatível com o passado, o que significa que, se o passado era meio desajeitado, parte do presente também é meio desajeitado”, disse Mark Surabian, consultor da CAA.

Surabian, 61 anos, treinou administradores e fonoaudiólogos em centenas de escolas durante 35 anos. Ele lecionou para alunos de pós-graduação em quase todos os programas de treinamento de professores de educação especial da cidade de Nova York, incluindo os da Columbia Teachers College e da New York University. Ele é especialista em personalizar aplicativos CAA prontos para atender às necessidades específicas de seus próprios clientes e fez carreira como o indispensável “técnico” que faz parceria com fonoaudiólogos, professores e neuropsicólogos para encontrar o hardware e o software certos para seus clientes.

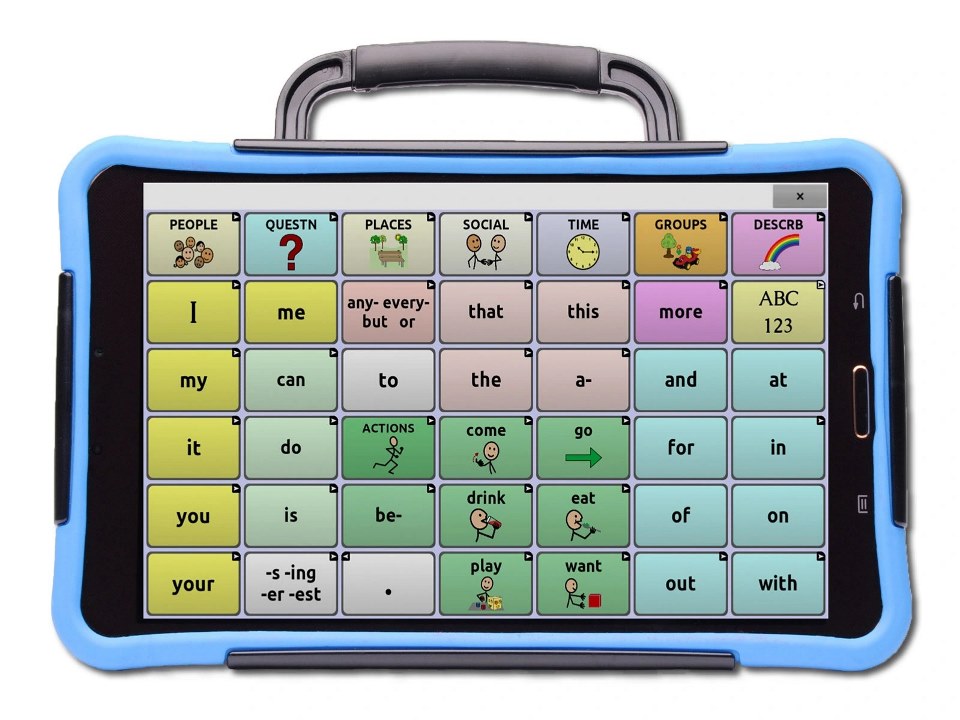

A tela padrão do TouchChat do dispositivo de comunicação da PRC-Saltillo, por exemplo, consiste em 12 linhas de oito botões que exibem uma mistura de letras, ícones de objetos (“maçã”), ícones de categorias (“comida”) e elementos de navegação (setas para trás), muitos deles em cores neon berrantes. Parte do que considero irritante na interface é como ela trata cada botão de forma semelhante – todos têm o mesmo tamanho, 200 por 200 pixels, e não há uma lógica óbvia para o posicionamento dos botões, o tamanho do texto ou a capitalização. Algumas palavras são estranhamente abreviadas (“DESCRB”), enquanto outras (“obrigado”) são reduzidas para caber na largura da caixa. Além do fato de ser redundante com “good” (um polegar para cima apenas com a mão), “yes” e “like” (ambos rostos sorridentes), e se o usuário quiser dizer “cool” em termos de temperatura?

Os princípios estabelecidos de hierarquia de informações e design de interface para dispositivos AAC não são padrão – cabe à Surabian definir o número e o tamanho dos botões em cada tela, bem como o tamanho do ícone, o tamanho do tipo e se a posição de um botão deve mudar ou permanecer fixa.

“Tudo se move lentamente porque precisa ser compatível com o passado, o que significa que se o passado foi meio desajeitado, parte do presente também é meio desajeitado.”

Mark Surabian, consultor da CAA

Liguei para Surabian na esperança de ser surpreendida. Quando ele e eu nos encontramos em um café na parte baixa de Manhattan, fiquei empolgada com a pasta que ele carregava, achando que ele poderia me mostrar as coisas mais legais que estavam acontecendo na CAA. Mas fiquei novamente decepcionada.

Porque a realidade é esta: o último grande avanço na tecnologia CAA ocorreu há 13 anos, uma eternidade no tempo tecnológico. Em 3 de abril de 2010, Steve Jobs lançou o iPad. O que para a maioria das pessoas era basicamente um formato mais conveniente, para os não-falantes era algo muito mais importante: uma revolução que mudou a vida do acesso a um dispositivo de comunicação atraente, portátil e poderoso por apenas algumas centenas de dólares. Assim como os smartphones, os iPads tinham telas sensíveis ao toque integradas, mas com a principal vantagem de ter mais espaço para exibir dezenas de botões baseados em ícones em uma única tela. E, pela primeira vez, os usuários de CAA podiam usar o mesmo dispositivo que usavam para falar para fazer outras coisas, como enviar mensagens de texto, FaceTime, navegar na Web, assistir a filmes, gravar áudio e compartilhar fotos.

“Os distritos escolares e os pais estavam comprando um iPad, trazendo-o para nós e dizendo: ‘Faça isso funcionar'”, escreveram Heidi LoStracco e Renee Shevchenko, duas fonoaudiólogas da Filadélfia que trabalham exclusivamente com crianças que não falam. “Chegou ao ponto de alguém nos pedir aplicativos para iPad para CAA todos os dias. Nós lhes dizíamos: ‘Ainda não existe um aplicativo CAA eficaz, mas quando houver, seremos os primeiros a informá-lo’.”

Uma peça de hardware, mesmo que tenha sido projetada e desenvolvida de forma impressionante, só tem valor se a pessoa puder usá-la. Após o lançamento do iPad, a enxurrada de aplicativos CAA novos e fáceis de usar que LoStracco, Shevchenko e seus clientes queriam nunca chegou.

Atualmente, há cerca de meia dúzia de aplicativos, cada um vendido por US$ 200 a US$ 300, que se baseiam em convenções de 30 anos atrás, solicitando aos usuários que selecionem entre menus de ícones grosseiramente desenhados para produzir texto e fala sintetizada. Além do alto preço, a maioria dos aplicativos de CAA exige a personalização por um especialista treinado para ser útil. Esse pode ser o motivo pelo qual o acesso continua sendo um problema; LoStracco e Shevchenko afirmam que apenas 10% das pessoas que não falam nos EUA estão usando a tecnologia. (O ‘AAC Counts’, um projeto da CommunicationFIRST, uma organização nacional de defesa de pessoas com deficiências de fala), destacou recentemente a necessidade de melhores dados sobre os usuários de CAA.

Na tela padrão do TouchChat do dispositivo de comunicação NovaChat, todos os botões têm o mesmo tamanho e não há lógica óbvia para o posicionamento dos botões, o tamanho do texto ou a capitalização.

Não há muitas outras opções disponíveis, embora as possibilidades dependam das habilidades do usuário. Não falantes alfabetizados com controle motor total dos braços, mãos e dedos, por exemplo, podem usar um software de conversão de texto em fala prontamente disponível em um smartphone, tablet, computador de mesa ou laptop. Aqueles cujo controle motor fino é limitado também podem usar esses aplicativos com a ajuda de um ponteiro a laser controlado pelos olhos, um ponteiro físico preso à cabeça ou outra pessoa para ajudá-los a operar uma tela sensível ao toque, um mouse ou um teclado. As opções diminuem para usuários pré-alfabetizados e com deficiência cognitiva que se comunicam com vocabulários baseados em imagens. Para minha filha, fiquei intrigada com uma opção de “tecnologia intermediária” — o Logan ProxTalker, um console de 13 polegadas com um alto-falante embutido e um kit de etiquetas sonoras habilitadas para RFID. Uma das cinco estações no console reconhece as etiquetas, cada uma pré-programada para falar seu ícone exclusivo. Mas então vi seu preço, US$ 3.000 por 140 tags. (Para fins de contexto, os Institutos Nacionais de Saúde estimam que uma criança média de cinco anos pode reconhecer mais de 10.000 palavras).

É difícil pensar que se espera que os consumidores sem deficiência aceitem o mesmo ritmo lento de melhorias incrementais para uma função humana tão essencial quanto a fala.

Fico sonhando com as interfaces cérebro-computador anunciadas como a próxima fronteira — implantes que enviariam sinais do sistema nervoso central diretamente para um computador, sem nenhuma voz ou ativação muscular. Mas o conceito de BCIs está repleto de questões éticas significativas e legítimas. Em parte, por esse motivo, as BCIs estão muito distantes para serem levadas a sério no momento. Enquanto isso, no presente medíocre, é difícil pensar que os consumidores não deficientes devam aceitar o mesmo ritmo lento de melhorias incrementais para uma função humana tão essencial quanto a fala.

No final dos anos 2000, as empresas de CAA se prepararam para uma grande mudança. Quando conversei com Sarah Wilds, diretora de operações da PRC-Saltillo, ela descreveu o clima na reunião anual da empresa em 2008, ano em que começou a trabalhar lá.

“Estávamos todos os fonoaudiólogos [juntos] nesta sala”, contou Wilds, “e alguém disse: ‘Existe uma coisa chamada iPod Touch’. E todos disseram: ‘Nós temos computadores. Por que alguém iria querer uma tela pequena?”.

“No ano seguinte, as pessoas disseram: ‘Oh, meu Deus, eles estão fazendo isso – e se as telas ficarem maiores? E no ano seguinte, o iPad estava aqui. Ficamos todos horrorizados com o fato de que qualquer pessoa poderia ir à loja, escolher um e colocar um aplicativo nele.”

Ou seja, horrorizados, porque presumiam que a nova tecnologia reduziria radicalmente o preço dos tipos de ferramentas que estavam produzindo e vendendo. Os desenvolvedores de CAA, em contraste com uma empresa como a Apple, não estavam preparados para vender seu software diretamente para as massas em 2010. Os poucos desenvolvedores de CAA nos EUA — a PRC, Saltillo e Dynavox eram os maiores — vinham realizando operações modestas de fabricação e venda de programas pré-carregados em seu hardware proprietário desde a década de 1980 (embora a PRC tenha lançado seu primeiro dispositivo em 1969). Seus fundadores, ex-linguistas e fonoaudiólogos, eram otimistas em relação ao potencial da tecnologia; eles também eram realistas e reconheciam que a comunicação assistiva nunca seria um negócio em expansão. O mercado de comunicação assistiva era, e ainda é, relativamente pequeno. De acordo com o National Institute on Deafness and Other Communication Disorders (Instituto Nacional de Surdez e Outros Distúrbios da Comunicação), entre 5% e 10% das pessoas que vivem nos Estados Unidos têm problemas de fala, e apenas uma pequena fração delas precisa de dispositivos de assistência.

Quando perguntei a Wilds quantas pessoas usam os produtos da PRC-Saltillo, ela se esquivou, observando que a empresa é privada e não divulga publicamente seus balanços. Sobre o cenário em geral, ela disse o seguinte: a demanda dos clientes por aplicativos desenvolvidos por empresas de CAA geralmente é 10 vezes maior do que a demanda por seus produtos de hardware. Ah, e sobre esse “dispositivo especial de hardware de comunicação dedicado”, provavelmente é um iPad.

No outono de 2022, quando comecei a procurar um dispositivo para minha filha, seu fonoaudiólogo me indicou o AbleNet, um fornecedor terceirizado de tecnologia assistiva. Os distritos de escolas públicas nos EUA também podem adquirir dispositivos CAA em nome de alunos que precisam deles, mas, na época, minha filha não era elegível porque o dispositivo não estava listado em seu programa educacional individualizado. Um representante da AbleNet me enviou uma cotação de um Quick Talker Freestyle, um “dispositivo de fala baseado em iPad” pelo qual eles cobrariam US$ 4.190 do nosso plano de saúde. O representante me garantiu que a “contribuição da família” seria de apenas US$ 2.245.

Por esse preço, certamente o Quick Talker Freestyle ofereceria algo mais avançado do que um aplicativo que eu poderia baixar no iPad recondicionado que eu já havia comprado da Apple por US$ 279 (um novo iPad de nona geração é vendido por US$ 329.) Quando insisti em obter detalhes, fui encaminhado a um supervisor de assistência de benefícios, que sugeriu que eu me inscrevesse no plano de pagamento da empresa (não o fiz). Mais tarde, fiquei sabendo que, para atender às exigências do Medicaid e do seguro de saúde, os fornecedores terceirizados de tecnologia CAA geralmente retiram os aplicativos nativos da Apple dos iPads que distribuem, tornando-os menos úteis, por um preço 10 ou 20 vezes maior, do que o mesmo hardware que eu (ou qualquer outra pessoa) possa comprar na prateleira.

Quando entrei em contato com a AbleNet para comentar o assunto, Joe Volp, vice-presidente de marketing e relações com o cliente, detalhou os benefícios de atendimento ao cliente incorporados ao preço, incluindo um período de teste do dispositivo, uma garantia ilimitada de cinco anos e um retorno rápido para reparos. Essas são boas opções, mas não chegam nem perto de justificar o preço elevado.

Contei a Wilds sobre minha experiência e ela pareceu genuinamente compreensiva. “Acho que é muito difícil ser uma empresa que trabalha apenas com aplicativos no mundo da tecnologia assistiva”, explicou. Ela sugeriu que as empresas de CAA precisam vender hardware caro para financiar o desenvolvimento de seus aplicativos.

A maioria das empresas de CAA foi criada por especialistas em desenvolvimento de tecnologia, não em distribuição. Pelo menos nas últimas três décadas, elas desenvolveram seus produtos como dispositivos médicos aprovados pela FDA (Food and Drug Administration) para aumentar as chances de que o Medicaid, as seguradoras privadas de saúde e os distritos escolares paguem por eles. Para compensar o pequeno tamanho do mercado, os desenvolvedores recorreram a um modelo de negócios complicado que exigia que um médico ou fonoaudiólogo licenciado “prescrevesse” formalmente o dispositivo, estrategicamente (e astronomicamente) precificado para subsidiar o custo de seu desenvolvimento.

Antes de 2010, as empresas que criavam seu próprio hardware e software de CAA do zero podiam se safar mantendo sua estratégia de preços opaca. Mas quando a Apple produziu em massa uma versão melhor do hardware que elas estavam desenvolvendo internamente, a fumaça e os espelhos desapareceram, expondo um sistema que se assemelha muito a uma manipulação de preços.

Mas seria muito fácil chamar as empresas de CAA de vilãs; considerando que elas operam no mesmo sistema orientado pelo mercado que os produtos de tecnologia de consumo mais populares do mundo, é um pequeno milagre que elas sequer existam. E o problema de aumentar os preços dos produtos para cobrir o custo de seu desenvolvimento não é exclusivo. Com muita frequência — na ausência de uma entidade pública ou privada que financie proativamente uma tecnologia altamente especializada com o potencial de mudar, ou até mesmo salvar, um pequeno número de vidas — a norma é alguma forma de aumento de preço.

Talvez minhas expectativas não estejam corretas. Pode ser ingênuo esperar que uma tecnologia de CAA acessível e inovadora surja das mesmas condições que sustentam bilhões de pessoas que vendem maquiagem e publicam selfies. Talvez seja necessário haver uma área totalmente separada, com seus próprios incentivos, para o desenvolvimento de produtos tecnológicos destinados a pequenas populações de pessoas que realmente poderiam se beneficiar deles.

Em março, Savarese concordou em me encontrar on-line para uma conversa ao vivo. (A partir de nossas trocas de e-mails, percebi que ele se sentia mais confortável em se comunicar de forma assíncrona, por escrito). Eu lhe enviei uma lista de perguntas com antecedência. Queria saber o que ele pensava sobre alguns tópicos nada fáceis e não queria que a inconveniência do meio ao vivo limitasse o que ele tinha a dizer.

Alguns minutos antes de nossa reunião agendada, Savarese me enviou por e-mail um documento do Word de oito páginas, no qual ele copiou minhas perguntas e acrescentou suas respostas. Reconheci minhas próprias perguntas, bem como algumas de suas respostas — uma mistura de passagens citadas de seus escritos anteriores e algum material novo que ele havia digitado.

“Imaginar que a tecnologia sozinha pode nos libertar é um pouco míope e, de certa forma, incapacitante.”

David James “DJ” Savarese

Uma pergunta sobre dispositivos de CAA que Savarese acrescentou à minha lista: “Eles melhoraram?” Ao que ele respondeu: “Claro: mais leves, mais baratos, consolidaram todas as minhas necessidades de comunicação e trabalho baseadas em palavras em um dispositivo pequeno (laptop ou iPad). A sutileza das vozes está melhorando, embora eu tenha optado por usar a mesma voz ao longo dos anos e não consiga chegar perto de reproduzir o som de um poema que escrevi sem treinar e gravar um poeta confiável e falante lendo-o em voz alta.”

Considerando a existência do documento do Word — que era essencialmente a transcrição de uma entrevista que eu estava prestes a realizar — qual seria o objetivo de nossa conversa ao vivo? Sugeri a Savarese que eu lesse o documento em voz alta — pelo menos as palavras que eu mesma havia escrito. Pareceu-me invasivo usar minha voz para ler as respostas de Savarese; ele fica compreensivelmente frustrado com a tendência dos outros de falar por ele.

Em vez disso, pedi que ele colasse suas respostas pré-escritas na janela de bate-papo ou que usasse a função ler em voz alta para dizê-las. No decorrer da entrevista, parafraseei suas respostas e fiz perguntas de acompanhamento para garantir que eu o estivesse interpretando corretamente. Segui seu exemplo ao alternar entre os modos de comunicação.

Savarese relembra seus primeiros anos de CAA com surpreendente saudosismo: “Em vez de insistir para que eu me juntasse ao mundo da fala deles, meus pais aprenderam esses novos idiomas comigo.”

ALI LAPETINA

Dessa forma, Savarese falou sobre sua história pessoal de comunicação aumentativa e alternativa. Quando tinha seis anos de idade, ele aprendeu a linguagem de sinais com seus pais que não têm deficiência. Na escola primária, eles o equiparam com uma máquina de etiquetas de US$ 17 da Staples para ensinar a ele palavras visuais e ajudá-lo aprender a ler e digitar. Na quarta série, Savarese começou a digitar seus pensamentos em um computador pessoal chamado Gemini, uma versão aprimorada de US$ 12.000 de um laptop da Apple do final dos anos 90.

O Gemini exigia uma tomada elétrica e um professor para ajudá-lo a movê-lo. De acordo com os requisitos do Medicaid (que obrigam os fabricantes a removerem recursos que possam tentar os pais a usar o dispositivo por conta própria), ele não tinha processador de texto nem acesso à Internet. Savarese se adaptou continuando a usar sua máquina de etiquetas para preencher testes e escrever poemas e histórias. Para escrever mais rápido, ele montou tiras de papel pré-impressas com palavras e frases usadas com frequência, retiradas de um banco de palavras criado por sua mãe.

“Na época, era muito importante para mim ter o que parecia ser meu próprio computador”, disse-me Savarese. “Portanto, esse status compensava a inconveniência.”

Savarese relembra seus primeiros anos de CAA com surpreendente saudosismo: “Em vez de insistirem para que eu me juntasse ao mundo da fala deles”, ele me disse, “meus pais aprenderam esses novos idiomas comigo… Essas tecnologias eram mais multissensoriais, mais comunitárias e, de certa forma, mais democráticas; com imagens, linguagem de sinais e palavras visuais tangíveis, meus pais, professores, amigos e eu éramos todos aprendizes, todos professores”. Quando ele estava na 10ª série, o software de conversão de texto em fala finalmente era onipresente o suficiente para vir pré-instalado em um laptop – um dispositivo único e leve que deu a Savarese a capacidade de se comunicar tanto silenciosamente quanto em voz alta.

“Imaginar que a tecnologia por si só pode nos libertar é um pouco míope e, de certa forma, incapacitante”, ele digitou para mim. Mas ele tem uma lista de desejos de melhorias, a começar por uma voz mais alta incorporada em laptops, tablets e smartphones para que os outros possam ouvi-lo melhor. Ele gostaria de ter um software de apresentação de slides com opções personalizáveis de leitura de scripts, para que os usuários possam sincronizar sua narração com a mudança dos slides. Ele também acha que a previsão de palavras tem um longo caminho a percorrer para se tornar realmente útil e menos prescritiva.

No entanto, a atitude de Savarese em relação à tecnologia CAA continua realista e até generosa. “Vivo em uma sociedade/mundo centrado na fala, portanto, preciso ter uma forma de comunicação baseada na fala para a maioria das pessoas”, ele me disse. “Consigo ganhar a vida como escritor, cineasta, apresentador, colaborador e ativista (inter)nacional. Meus dispositivos CAA me deram a voz pública de que eu precisava para existir como um membro essencial dessas comunidades.”

A recompensa para Savarese e para seu público é grande: “Acho que isso talvez tenha melhorado para mim à medida que envelheci. As pessoas estão interessadas em ouvir o que tenho a dizer.”

Julie Kim é uma escritora que vive em Nova York.