Em 2014, pesquisadores no MIT Media Lab desenvolveram um experimento chamado Máquina Moral. A ideia era criar uma plataforma semelhante a um jogo que coletasse informações quanto às decisões dos participantes sobre quem carros autônomos deveriam priorizar em diferentes variações do “Dilema do Bonde”. Neste processo, os dados gerados forneceriam percepções sobre as prioridades éticas coletivas de diferentes culturas.

A recepção viral do experimento surpreendeu os pesquisadores. Quatro anos após a plataforma ir ao ar, milhões de pessoas em 233 países e territórios registraram 40 milhões de decisões, tornando-o um dos maiores estudos globais já feitos sobre preferências morais.

Um artigo publicado pela Nature em 2018 demonstrou a análise destes dados e evidencia o quanto éticas interculturais divergem com base na cultura, economia e localização geográfica.

O clássico dilema do bonde funciona assim: um bonde desgovernado segue em alta velocidade pelos trilhos prestes a atingir e matar cinco pessoas. Você tem acesso a uma alavanca que pode mudar o bonde para um trilho diferente, onde uma pessoa diferente encontrará seu inesperado fim. Você deveria puxar a alavanca e acabar com uma vida para poupar cinco?

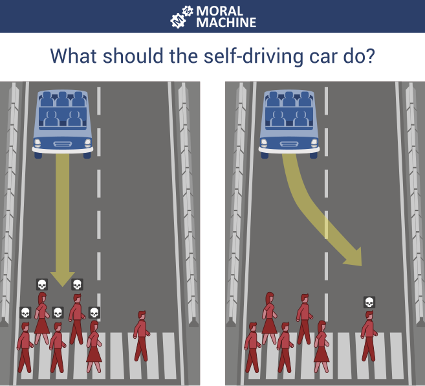

A Máquina Moral resolveu testar esta ideia com os nove pares que mais dividiram os participantes: o carro autônomo deveria dar prioridade a seres humanos ou animais de estimação, passageiros ou pedestres, mais vidas ou menos vidas, mulheres ou homens, jovens ou idosos, indivíduos saudáveis ou doentes, de mais prestígio social ou menos, cumpridores da lei ou criminosos? E finalmente, o carro deveria desviar (ação ativa) ou permanecer no curso (ação passiva)?

O que o carro autônomo deveria fazer? – Um exemplo de pergunta imposta aos participantes da Máquina da Moral.

Máquina da Moral

Mais do que apresentar casos individuais, no entanto, o experimento mostrou aos participantes várias combinações, por exemplo, se o carro autônomo deveria seguir em frente e atropelar três pedestres idosos ou desviar em direção a uma barreira e três passageiros jovens morrerem.

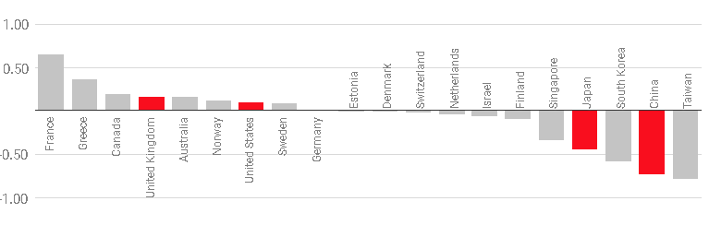

Os pesquisadores descobriram que as preferências dos países se alteravam com uma diferença considerável, mas se correlacionavam fortemente com a cultura e economia. Por exemplo, participantes de culturas coletivistas como as da China e Japão são menos propensos a salvar jovens no lugar dos idosos, os pesquisadores cogitaram a hipótese de isto ser devido à grande importância do respeito com idosos.

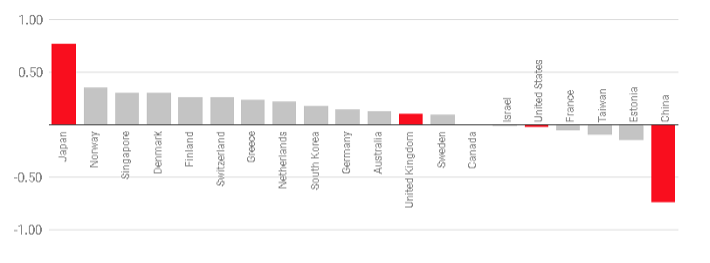

Países com culturas mais individualistas são mais propensos a salvar os jovens

Uma comparação entre países pilotando carros autônomos: se a barra estiver próxima do 1, entrevistados deram mais importância em salvar os jovens; -1, mais importância em salvar os idosos; 0 é a média global.

Criado com Datawrapper

Do mesmo modo, participantes de países mais pobres com instituições enfraquecidas são mais tolerantes com pedestres imprudentes do que com pedestres que fazem o cruzamento corretamente. E participantes de países com alto nível de desigualdade econômica mostram maiores lacunas entre o tratamento de indivíduos com status social alto e baixo.

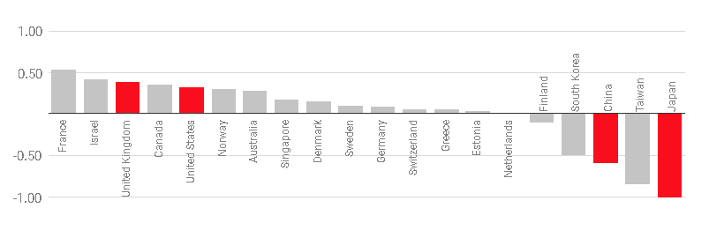

E, no que se resume à questão essencial do dilema do bonde, os pesquisadores descobriram que o grande número de pessoas em perigo não era sempre o fator dominante para escolher qual grupo deveria ser salvo. Os resultados mostraram que os participantes vindos de culturas individualistas como as do Reino Unido e Estados Unidos, deram maior ênfase em salvar mais vidas apesar de todas as outras opções — possivelmente, na opinião dos autores, isto seja devido à grande importância sobre o valor de cada indivíduo.

Países com culturas mais individualistas são mais propensos a salvar mais vidas

Uma comparação entre alguns países pilotando carros autônomos: se a barra estiver mais próxima do 1, entrevistados depositaram mais importância em salvar mais vidas; -1, menos importância em salvar mais vidas; 0 é a média global.

Criado com Datawrapper

Países com grande proximidade entre si também mostraram proximidade nas preferências morais com três grupos principais no oeste, leste e sul.

Os pesquisadores reconheceram que os resultados poderiam ser tendenciosos, já que os participantes no estudo foram autosselecionados, e, portanto, mais propensos a estar conectados à internet, a ter alta posição social e conhecimentos tecnológicos. Mas os interessados em dirigir carros autônomos provavelmente também teriam essas características.

O estudo faz implicações interessantes para países que atualmente estão testando esses automóveis, uma vez que estas preferências poderiam servir para moldar a concepção e regulamentação de tais veículos. As montadoras de carros podem descobrir, por exemplo, que os consumidores chineses entrariam mais prontamente em um carro que os protegesse em detrimento dos pedestres.

Comparação entre países que salvariam pedestres em vez de passageiros

Se a barra estiver mais próxima do 1, entrevistados deram mais importância em salvar pedestres; -1, mais importância em salvar passageiros; 0 é a média global.

Contudo, os autores do estudo enfatizaram que os resultados não tem a intenção de ditar como os diferentes países deveriam agir. Na verdade, em alguns casos, os autores sentiram que tecnólogos e legisladores deveriam sobrepor-se à opinião pública coletiva. Edmond Awad, um dos autores do artigo, elencou como um exemplo a comparação de status social. “Parece preocupante que as pessoas realmente consideraram aceitável a um nível significativo salvar alguém de maior prestígio acima de alguém com menos”, diz ele. “É importante dizer, ‘Isso pode ser quantificado’ ao invés de dizer, ‘Hm, talvez devêssemos usar isso.’” Os resultados, ele disse, deveriam ser usados pela indústria e pelo governo como base para compreender como o público reagiria à ética de diferentes concepções e decisões políticas.

Awad espera que os resultados também ajudem tecnólogos a refletirem mais sobre as éticas da IA para além de carros autônomos. “Usamos o dilema do bonde porque é uma ótima maneira de coletar esses dados, mas esperamos que a discussão de ética não fique restrita a este tema,” disse ele. “A discussão deveria avançar para análises de risco, sobre quem é mais ou menos vulnerável, ao invés de dizer quem irá morrer ou não, e também sobre como o preconceito está acontecendo”. Ele espera estudar mais no futuro como estes resultados podem ser traduzidos em uma concepção e regulamentação mais ética de IA.

“Nos últimos dois ou três anos mais pessoas têm dado início à conversa sobre ética na IA,” disse Awad, “Mais pessoas têm começado a se conscientizar que a IA poderia ter diferentes consequências éticas em diferentes grupos de pessoas. O fato de vermos pessoas comprometidas com isto, acredito ser algo promissor”.