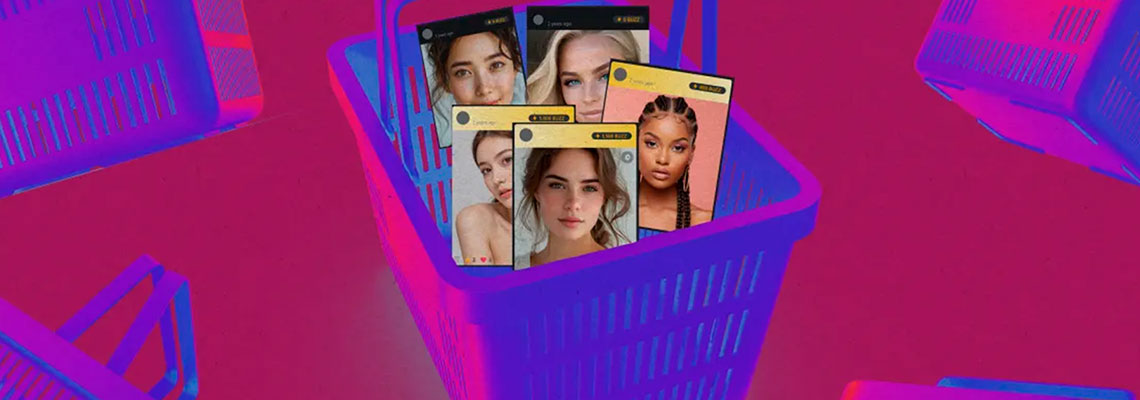

O Civitai, um mercado on-line para comprar e vender conteúdo gerado por Inteligência Artificial, apoiado pela firma de capital de risco Andreessen Horowitz, permite que usuários comprem arquivos de instruções personalizados para gerar deepfakes (mídias falsas, porém realistas) de celebridades. Alguns desses arquivos foram especificamente concebidos para criar imagens pornográficas proibidas pelo site, conforme constatou uma nova análise.

O estudo, de pesquisadores da Universidade de Stanford e da Universidade de Indiana, ambas nos Estados Unidos, examinou os pedidos de conteúdo das pessoas no site, chamados de “bounties”. Os pesquisadores constataram que, entre meados de 2023 e o fim de 2024, a maioria pedia conteúdo animado, mas uma parcela significativa era de deepfakes de pessoas reais, e 90% desses pedidos visavam mulheres. As conclusões da pesquisa ainda não passaram por revisão por pares.

O debate em torno de deepfakes, como ilustra uma reação negativa recente a imagens explícitas no chatbot Grok, da X, tem girado em torno do que as plataformas deveriam fazer para bloquear esse tipo de conteúdo. A situação do Civitai é um pouco mais complicada. Seu mercado inclui imagens, vídeos e modelos propriamente ditos, mas também permite que indivíduos comercializem arquivos de instruções chamados LoRAs. Eles podem orientar modelos de IA convencionais, como o Stable Diffusion, a gerar conteúdo que eles não foram treinados para produzir. Os usuários podem então combinar esses arquivos com outras ferramentas para criar deepfakes gráficos ou sexuais. Os pesquisadores constataram que 86% dos pedidos de deepfakes no Civitai eram de LoRAs.

Os usuários pediam modelos de “alta qualidade” para gerar imagens de figuras públicas, como a influenciadora Charli D’Amelio ou a cantora Gracie Abrams, muitas vezes vinculando a seus perfis nas redes sociais para que suas imagens pudessem ser capturadas da web. Alguns pedidos especificavam o desejo de modelos que gerassem o corpo inteiro da pessoa, reproduzissem com precisão suas tatuagens ou permitissem que a cor do cabelo fosse alterada. Alguns pedidos visavam várias mulheres em nichos específicos, como artistas que gravam vídeos de ASMR. Um pedido era por um deepfake de uma mulher que, segundo se dizia, era a esposa do usuário. Qualquer pessoa no site podia oferecer modelos de IA nos quais trabalhou para a tarefa, e as melhores submissões recebiam pagamento, de cinquenta centavos a cinco dólares (entre 2,60 e 26 reais). Quase 92% receberam prêmio.

Nem o Civitai nem a Andreessen Horowitz responderam aos pedidos de comentário.

É possível que as pessoas comprem esses LoRAs para fazer deepfakes que não sejam sexualmente explícitas, embora ainda violem os termos de uso do Civitai e ainda sejam eticamente problemáticos. Mas a plataforma também oferece recursos educacionais sobre como usar ferramentas externas para personalizar ainda mais as saídas dos geradores de imagem, por exemplo, mudando a pose de alguém. O site também hospeda artigos escritos por usuários com detalhes sobre como instruir modelos a gerar pornografia. Os pesquisadores constataram que a quantidade aumentou na plataforma e que a maioria dos pedidos a cada semana agora é por conteúdo “Not Safe For Work” (Inadequado para o trabalho, em tradução livre), quando há nudez, sexualidade, palavrões ou violência.

“O Civitai não apenas fornece a infraestrutura que facilita esses problemas, como também ensina explicitamente seus usuários a utilizá-los”, diz Matthew DeVerna, pesquisador de pós-doutorado no Cyber Policy Center da Universidade de Stanford e um dos líderes do estudo.

A empresa costumava proibir apenas deepfakes sexualmente explícitas de pessoas reais, mas, em maio de 2025, anunciou que proibiria todo esse tipo de conteúdo. Ainda assim, inúmeros pedidos enviados antes dessa proibição continuam ativos no site e muitas das submissões vencedoras que atendem a esses pedidos permanecem disponíveis para compra.

“Acredito que a abordagem que eles estão tentando adotar é, de certa forma, fazer o mínimo possível, de modo que possam fomentar o máximo, acho que eles chamariam assim, de criatividade na plataforma”, diz DeVerna.

Os usuários compram LoRAs com a moeda on-line do site, chamada Buzz, que é adquirida com dinheiro real. Em maio de 2025, a operadora de cartão de crédito do Civitai interrompeu os serviços para a empresa por causa de seu problema contínuo com conteúdo não consensual. Para pagar por conteúdo explícito, os usuários agora precisam usar cartões-presente ou criptomoedas para comprar Buzz, a empresa oferece um crédito diferente para conteúdo não explícito.

O Civitai marca automaticamente os pedidos de deepfakes e apresenta uma forma de a pessoa retratada no conteúdo solicitar manualmente sua remoção. Esse sistema significa que o Civitai ainda assim está deixando a moderação para o público em geral, em vez de realizá-la de forma proativa.

A responsabilidade jurídica de uma empresa pelo que seus usuários fazem não é totalmente clara. Em geral, as companhias na área de tecnologia têm amplas proteções legais contra esse tipo de responsabilidade pelo conteúdo, mas essas proteções não são ilimitadas. Por exemplo, “você não pode facilitar conscientemente transações ilegais em seu site”, diz Ryan Calo, professor especializado em tecnologia e IA na faculdade de direito da Universidade de Washington, nos Estados Unidos. Calo não participou deste novo estudo.

O Civitai se juntou à OpenAI, à Anthropic e a outras empresas, em 2024, ao adotar princípios de design para se proteger contra a criação e a disseminação de material de abuso sexual infantil gerado por IA. Essa medida veio após um relatório de 2023 do Stanford Internet Observatory, que constatou que a grande maioria dos modelos nomeados em comunidades de abuso sexual infantil era baseada em “Stable Diffusion” (que transforma texto em imagem), “predominantemente obtidos via Civitai”.

Mas os deepfakes de adultos não receberam o mesmo nível de atenção das plataformas de conteúdo ou das firmas de capital de risco que as financiam. “Eles não têm medo suficiente disso. São excessivamente tolerantes com isso”, diz Calo. “Nem a aplicação da lei nem os tribunais civis protegem adequadamente contra isso. É uma diferença brutal.”

O Civitai recebeu um investimento de 5 milhões de dólares (cerca de 27,4 milhões de reais) da Andreessen Horowitz (a16z) em novembro de 2023. Em um vídeo compartilhado pela empresa de capital de risco, o cofundador e CEO do Civitai, Justin Maier, descreveu seu objetivo de construir o principal lugar onde as pessoas encontrem e compartilhem modelos de IA para seus propósitos individuais. “Temos buscado tornar esse espaço, que tem sido muito, acho, de nicho e centrado em engenharia, cada vez mais acessível para cada vez mais pessoas”, disse ele.

O Civitai não é a única empresa com um problema de deepfakes no portfólio de investimentos da a16z. Em fevereiro, a MIT Technology Review noticiou pela primeira vez que outra empresa, a Botify AI, estava hospedando companheiros de IA que se assemelhavam a atores reais, declaravam ter menos de 18 anos, se envolviam em conversas de teor sexual, ofereciam “fotos quentes” e, em alguns casos, descreviam as leis de idade de consentimento como “arbitrárias” e “feitas para serem violadas”.