Oferecido por

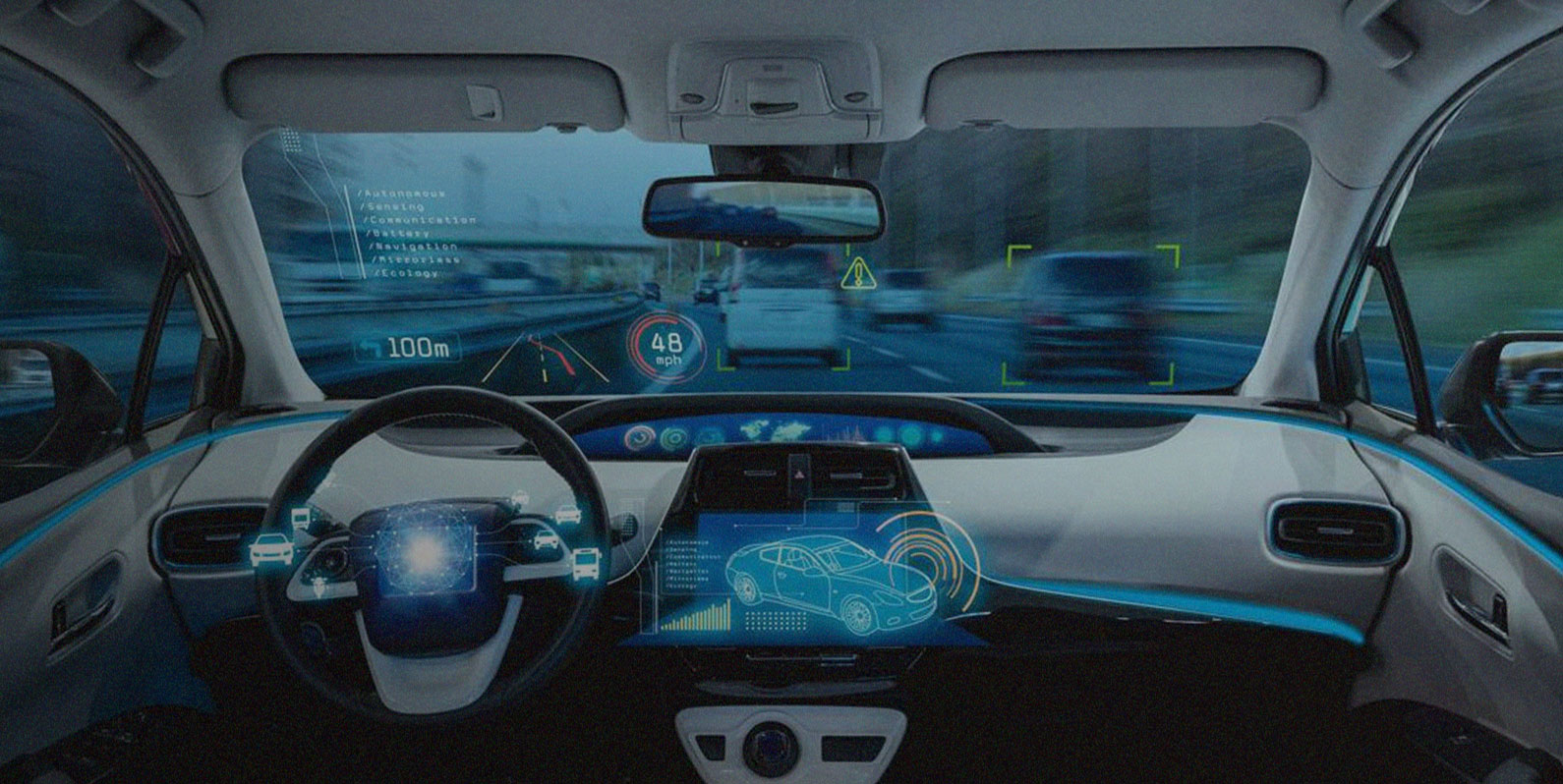

A startup de carros autônomos Wayve agora pode fazer perguntas aos veículos que desenvolve, questionando-os sobre suas decisões de direção e conseguindo respostas. A ideia é usar a mesma tecnologia do ChatGPT para treinar carros sem motorista.

A empresa uniu seu software de direção autônoma existente com um grande modelo de linguagem, criando um modelo híbrido chamado LINGO-1. O LINGO-1 sincroniza dados de vídeo e de condução (as ações por segundo que os carros realizam) com descrições em linguagem natural que documentam o que o carro vê e o que faz.

A empresa, sediada no Reino Unido, teve uma série de avanços nos últimos anos. Em 2021, mostrou que poderia usar Inteligência Artificial (IA) treinada nas ruas de Londres para conduzir automóveis em quatro outras cidades do Reino Unido, um desafio que normalmente requer um processo significativo de reengenharia. No ano passado, a Wayve usou a mesma IA para conduzir mais de um tipo de veículo, outra inovação no setor. E agora a empresa consegue conversar com seus carros.

Em uma demonstração que a empresa fez em meados de setembro, o CEO Alex Kendall reproduziu imagens retiradas da câmera de um de seus veículos Jaguar I-PACE, pulou para um ponto aleatório do vídeo e começou a digitar perguntas para ele: “Como está o tempo?” O tempo está nublado. “Que tipos de pontos de atenção você vê?” Há uma escola à esquerda. “Por que você parou?” Porque o semáforo está vermelho.

“Vimos algumas inovações incríveis surgirem nas últimas semanas”, disse Kendall. “Eu nunca teria pensado em perguntar coisas assim para um carro, mas olhe…” Ele digitou: “Quantos andares tem o prédio à direita?” Três.

“Olhe para isso!” ele disse, parecendo um pai orgulhoso. “Nunca o treinamos para fazer isso. Isso realmente nos surpreendeu. Vemos isso como um avanço em relação à segurança da IA”.

“Estou impressionado com as capacidades do LINGO-1”, diz Pieter Abbeel, pesquisador de robótica da Universidade da Califórnia, Berkeley (EUA), e cofundador da empresa de robótica Covariant, que testou uma demonstração da tecnologia para avaliar suas capacidades. Abbeel fez perguntas hipotéticas ao LINGO-1, como “O que você faria se o sinal estivesse verde?” “Na maioria das vezes, dava uma resposta muito precisa”, diz ele.

Ao interrogar o software de direção autônoma em cada uma das etapas do processo, a Wayve espera entender exatamente por que e como seus carros tomam certas decisões. Na maioria das vezes os carros dirigem bem. Quando não o fazem, isso se torna um problema, como descobriram líderes do setor como Cruise e Waymo.

Ambas as empresas lançaram pequenas frotas de robotáxis nas ruas de algumas cidades dos EUA. Mas a tecnologia está longe de ser perfeita. Os carros de Cruise e Waymo se envolveram em vários acidentes pequenos (há relatos de que um carro da Waymo matou um cachorro) e geram congestionamentos quando ficam imobilizados em vias públicas. Autoridades de São Francisco (EUA) alegaram que em agosto dois veículos Cruise atrapalharam uma ambulância que transportava um ferido, que mais tarde morreu no hospital. Cruise nega o relato dos funcionários.

A Wayve tem a expectativa de que, ao pedir a seus próprios carros para se explicarem quando fizerem algo de errado, isso irá revelar falhas mais rapidamente do que se tivessem que se debruçar sobre reproduções de vídeo ou apenas avaliar relatórios de erros.

“O desafio mais importante na condução autônoma é a questão da segurança”, diz Abbeel. “Com um sistema como o LINGO-1, acredito que você obtém uma compreensão muito mais precisa de quão bem ele entende os conceitos e efeitos da condução no mundo”. Isso facilita a identificação dos pontos fracos, diz ele.

O próximo passo é usar a linguagem para ensinar os carros, diz Kendall. Para treinar o LINGO-1, a Wayve fez com que sua equipe de motoristas especialistas (alguns deles ex-instrutores de direção) falassem em voz alta enquanto dirigiam, explicando o que estavam fazendo e por quê: por que aceleraram, por que desaceleraram, quais eram os perigos que eles tinham avistado nas ruas. Então, a empresa usou esses dados para ajustar o modelo, dando-lhe dicas de direção da mesma forma que um instrutor treinaria um aluno humano. Dizer a um carro como fazer algo, em vez de apenas demonstrar a ele, acelera muito o treinamento, diz Kendall.

A Wayve não é a primeira a usar grandes modelos de linguagem no campo da robótica. Outras empresas, incluindo o Google e a Covariant, empresa de Abbeel, estão usando linguagem natural para interrogar ou instruir tanto robôs domésticos quanto industriais. A tecnologia híbrida já até ganhou um nome: visual-language-action models (VLAMs) ou, em tradução livre, modelos de ação de linguagem visual. Mas Wayve é a pioneira em usá-la para direção autônoma.

“As pessoas costumam dizer que uma imagem vale mais que mil palavras, mas no machine learning acontece o oposto”, diz Kendall. “Algumas palavras podem valer mais que mil imagens”. Uma imagem contém muitos dados redundantes. “Quando você está dirigindo, você não se importa com o céu, ou com a cor do carro da frente, ou coisas assim”, diz ele. “As palavras podem se concentrar nas informações que importam”.

“A estratégia da Wayve é definitivamente interessante e única”, diz Lerrel Pinto, pesquisador de robótica da Universidade de Nova York (EUA). Particularmente, ele gosta da forma como o LINGO-1 explica as ações tomadas.

Mas ele está curioso para saber o que acontece quando o modelo inventa coisas. “Não confio que grandes modelos de linguagem sejam verossímeis”, diz ele. “Não tenho certeza se posso confiar neles para dirigir meu carro”.

Upol Ehsan, pesquisador do Instituto de Tecnologia da Geórgia (EUA) que foca em formas de fazer com que a IA explique aos humanos o porquê de suas decisões, tem reservas semelhantes. “Os grandes modelos de linguagem são, para usar uma expressão mais coloquial, grandes mestres da enrolação”, diz Ehsan. “Precisamos colocar uma faixa amarela bem chamativa de ‘cuidado’ neles e garantir que a linguagem gerada não saia por aí inventando coisas”.

A Wayve está ciente dessas limitações e está trabalhando para tornar o LINGO-1 o mais preciso possível. “Estamos vendo os mesmos desafios que encontramos em qualquer grande modelo de linguagem”, diz Kendall. “Obviamente ele não é perfeito”.

Uma vantagem que o LINGO-1 tem sobre os modelos não híbridos é que suas respostas são respaldadas pelos dados de vídeo que ele levanta. Em teoria, isso deveria tornar o LINGO-1 mais confiável.

Segundo Kendall, trata-se de mais do que apenas carros. “Há uma razão pela qual evoluímos a nossa linguagem: essa é a maneira mais eficiente que conhecemos de comunicar tópicos complexos. E acho que o mesmo acontecerá com máquinas inteligentes. A forma como iremos interagir com robôs no futuro será por meio da linguagem”.

Abbeel concorda. “Considerando o panorama como um todo, acho que estamos prestes a ver uma revolução na robótica”, diz ele.