O meio digital nos trouxe muitas facilidades e soluções interessantes para a evolução humana, mas, como tudo que é criado a partir da perspectiva humana, nos trouxe desafios e por vezes erros irreversíveis no primeiro momento. Ao longo da nossa trajetória na terra lidamos com a desinformação em diversos níveis e agora com a evolução dos meios tecnológicos de comunicação, enfrentamos desafios desconhecidos, mas que já nos mostram o impacto negativo na sociedade.

O debate sobre deepfakes não é essencialmente técnico, é sobretudo sociológico, pois manipulação de imagens são usados em diversas frentes e temas, logo, o fator importante é a finalidade dessas manipulações e do compartilhamento das imagens. Essencialmente, o debate sobre a manipulação de nossos rostos, corpos e vozes é muito maior do que será abordado neste artigo, mas, é importante entender mais este braço de uma sociedade infelizmente acostumada a toxicidades em suas ações.

O que são deepfakes?

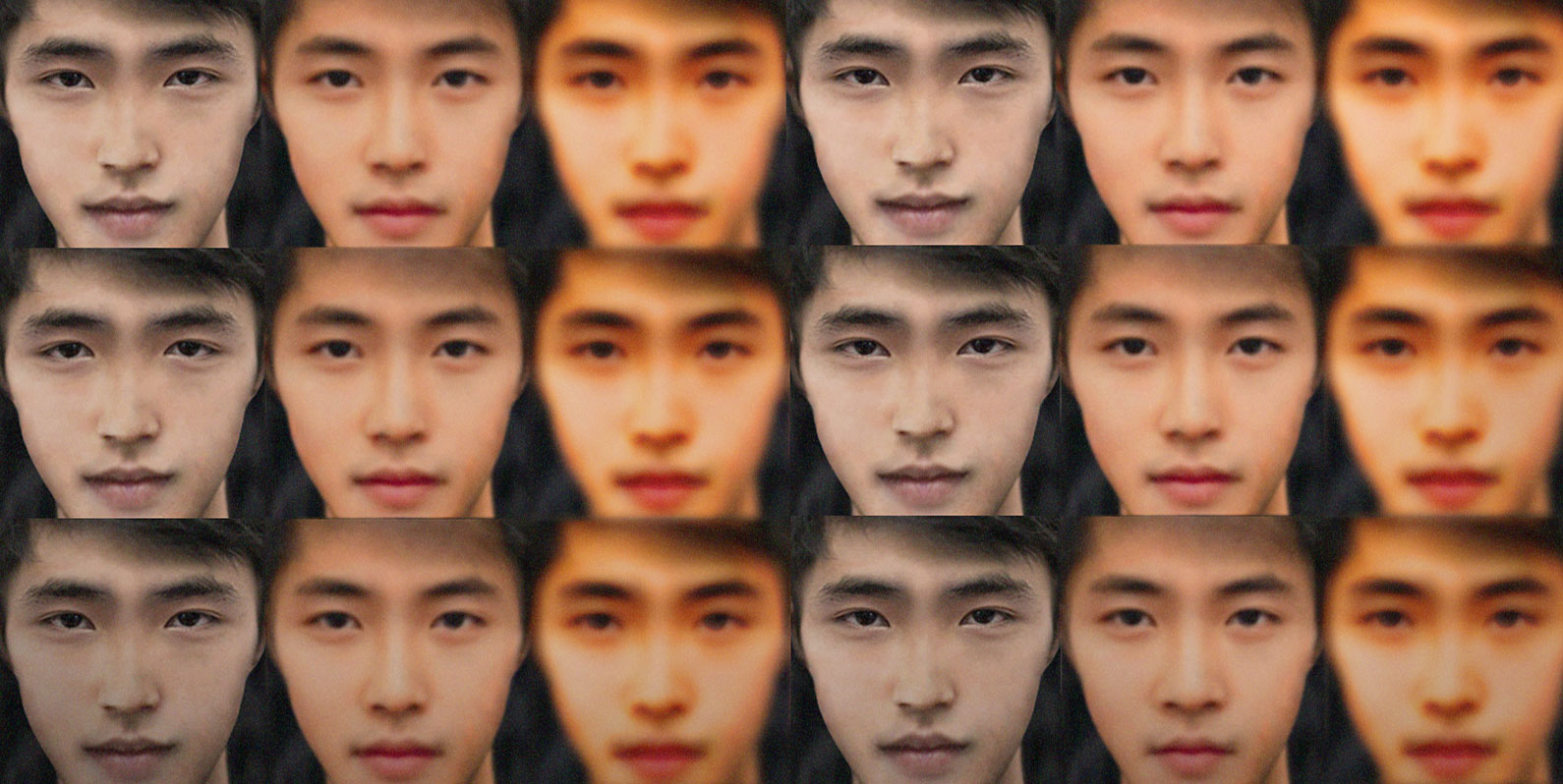

Deepfake é uma manipulação digital de videos e audios a partir do uso de técnicas computacionais conhecidas como redes neurais. Na prática, você alinha duas imagens de pessoas para conseguir reconstruir um rosto a partir do conjunto de características de outro rosto. Por mais que tenham desafios técnicos, o metódo se popularizou e atualmente existem diversas tecnologias de software livre que permitem a criação em poucos minutos de uma deepfake. Existem quatro tipos: face replacement, face reenactment, face generation, audio synthesis.

Há uma combinação de técnicas de redes neurais com técnicas de computação gráfica que permite sintetizar imagens e vídeos rapidamente. Se popularizou dizer que as redes neurais GANs (Generative Adversarial Networks) são mais simples, porém, pesquisadores afirmam que GANs são difíceis de trabalhar e requerem uma grande quantidade de dados de treinamento. Os modelos demoram mais para gerar as imagens do que com outras técnicas. E, o mais importante, os modelos GANs são bons para sintetizar imagens, mas não para fazer vídeos. Eles têm dificuldade em preservar a consistência temporal ou em manter a mesma imagem alinhada de um quadro para o outro. Por exemplo, em audiofakes, GANs não são usadas. Hoje, é mais correto afirmar que deepfakes são criadas por uma constelação de algoritmos de IA.

A popularização também se deve a evolução de ferramentas móveis para a criação de deepfakes. Qualquer pessoa com um smartphone e aplicativos específicos consegue criar uma deepfake. A popularização acaba por fazer com que se torne um pouco mais confuso entender como funciona a criação. O ciclo geral de criação de deepfake usando a técnica mais geral, a face replacement:

1 – A rede neural detecta e recorta a face da imagem que será acoplada no conteúdo falso;

2 – Técnicas especificas são usadas para separar as expressões do rosto para em seguida modificá-las;

3 – A representação intermediária do rosto/corpo é convertida na expressão desejada para a geração, isso antes de renderizar a imagem;

4 – Gera-se uma nova face com base em algum ponto focal (o rosto da imagem que serviu como base);

5 – A composição do conteúdo original é importante (cabelo, cena, etc ) combinado com uma renderização 3D, imagem distorcida do conteúdo gerado, etc., combinado com técnicas que refinam o realismo;

6 – Combina-se a face gerada e a cena de destino, para assim compartilhar o conteúdo falso;

Para áudio (fala), a abordagem mais comum é dividir o áudio em segmentos e, para cada segmento, medir os Coeficientes Mel-Cepstral (MCC), que capturam as frequências de voz dominantes para depois combinar com as imagens renderizadas em vídeo.

É muito mais complexo do que é compartilhado por aí, por isso é importante entendermos tecnicamente a criação de deepfake e também perceber que tem muita informação sendo compartilhada e que não condiz com a realidade da pesquisa em deepfakes.

Impactos de deepfakes nas redes sociais

Deepfakes se popularizaram a partir do uso de imagens de pessoas famosas como Nicolas Cage, um dos primeiros sucessos nas redes, e mais recentemente Tom Cruise. Sempre acompanhado de uma citação cômica, acabou se tornando uma febre entre os frequentadores virtuais. Percebendo isso, empresas começaram a tornar cada vez mais acessível a criação de deepfakes, hoje até plugins já existem para facilitar a criação destes videos.

Nas redes sociais, a circulação destas manipulações se popularizou muito rapido. O pico foi em 2017 quando estavam circulando muitas deepfakes pornográficas no Google e no Twitter. Mais recentemente, com a tensão política no Brasil, essas manipulações começaram a intensificar a desinformação nas redes sociais.

Para aprofundar mais sobre esse tema, conversei com o pesquisador Francisco Kerche, que realizou pesquisas utilizando métodos digitais para compreender a circulação de deepfakes nas redes sociais no Digital Methods Summer School da Universidade de Amsterdam. Ele compartilhou um pouco da evolução das deep fakes nas redes sociais :

“O Summer School conta com diversas pesquisas. Eu participei de duas: uma focada no mapeamento de deepfakes no ambiente digital e outra no estudo da desinformação gerada por “bots” no Instagram nas eleições de 2018. A perspectiva do primeiro estudo era entender como que o uso de deepfakes foi se alterando ao longo dos anos. No meu caso, entendi mais sobre o estudo das imagens e como eram ranqueadas no google. Primeiro realizamos um levantamento bibliográfico sobre deepfakes. A pesquisa em si estava focando em como os discursos envolvendo deepfakes poderiam circular nas redes. O próprio ato de desenvolver uma deepfake muitas vezes está conectado com tópicos perigosos na nossa sociedade, um exemplo que encontramos foi a forte ligação de deepfakes com pornografia. Por fim, queríamos entender também como diferentes atores observam esse fenômeno e como lidamos com isto ao longo do tempo”.

O pesquisador Francisco Kerche também lembra que “em 2017, o ápice da disseminação das deepfakes, era necessário muito mais imagens e processamento, e com o tempo novos atores começaram a se envolver, como aplicativos, cloud computing e outras empresas. Também em 2017, o grande foco era a pornografia, no nosso mapeamento isso ficou super visível. A pornografia era dividida em dois grandes grupos com muitas conexões entre si: um de pessoas brancas, maior e distante do resto dos temas, e outro, menor, de pessoas não brancas, demonstrando forte separação entre ambas”.

No ano seguinte, 2018, o cenário verificado pelos pesquisadores foi outro, como relata Kerche. “O xvideos, principal fonte de deepfakes no ano anterior, simplesmente sumiu das recomendações da Google. Percebemos que essa mudança brusca poderia apenas ocorrer partindo da moderação de conteúdo da Google. Esta teve grande impacto na forma como o conteúdo circulava como um todo. O mesmo também aconteceu no Twitter. A partir disso, começaram a popularizar fake news com figuras políticas, trazendo o risco da desinformação em massa. Com a deepfake do Obama, que viralizou bastante na rede, passamos a discutir “os perigos da deepfakes”. Porém, progressivamente, migramos para para ‘como detectar deepfakes’ muito atrelado à ideia de propor soluções técnicas para resolver problemas técnicos. Ou seja, mais tecnologia para resolver um problema que precisa justamente repensar a forma como usamos tecnologia”, conclui o pesquisador.

Os impactos de deepfakes na sociedade

Existem duas perspectivas amplas sobre as deepfakes nas quais devemos prestar atenção.

Na primeira delas, a preocupação são as imagens usadas. Muitas vezes as pessoas supõem que só figuras públicas serão utilizadas na manipulação, mas, esquecemos que no meio digital praticamente todos os perfis são públicos ou abertos. Sendo o seu perfil nas redes sociais aberto e sem nenhuma configuração de privacidade, qualquer pessoa terá acesso aos conteúdos compartilhados. A difamação é um risco, os vídeos nem precisam ser tão bons, a identificação da pessoa e do que ela está fazendo ou falando que importa, pois, isso deixa marca, principalmente se for um vídeo ou áudio negativo. As mulheres correm grandes riscos, pois a pornografia não consensual é responsável ainda por boa parte de conteúdos disseminados nas redes. Mas as mulheres não serão os únicos alvos de bullying.

Deepfakes podem muito bem permitir o bullying, em geral, seja em escolas ou locais de trabalho, já que qualquer um pode colocar as pessoas em cenários ridículos, perigosos ou comprometedores. Os impactos não são isolados, podemos combinar diferentes categorias como manipulação midiática, manipulação política, extorsão, intimidação. O risco começa no nível individual, mas, pode evoluir para um dano coletivo, pois o efeito cumulativo de deepfakes pode levar a danos graves no nível social.

Vale destacar alguns riscos que passam despercebidos em nossa vida digital, aquelas correntes que nos mostram em diferentes idades, por exemplo, fornecem aos algoritmos de IA informações valiosas sobre como as pessoas envelhecem e devem ser usadas com certa cautela, pensando até mesmo no compartilhamento de imagens de crianças nas redes. Lembro aqui do FaceApp e de outros aplicativos que necessitam dos nossos rostos para realizar trocas ou aumentos, ou qualquer outra manipulação digital. Frequentemente estes aplicativos são baseados fora das leis europeia e brasileira, o que dificulta a aplicação da legislação de proteção de dados.

A segunda perspectiva diz respeito à detecção de deepfakes. Desde 2017 aconteceram mudanças significativas no desenvolvimento e no acesso a estes conteúdos, por mais que ainda tenhamos muitos conteúdos de pornografia não consensual, o número diminuiu entre 2017 e 2018 dando espaço a temas como pânico moral e distopia e, neste caso, mora o perigo lucrativo, o que dificulta entender o futuro do combate a esta tecnologia, por vezes ela se mistura ao universo da informação em forma de memes, o que as tornas ainda mais virais.

As redes sociais, percebendo o impacto negativos das deepfakes nas eleições 2018 nos EUA e o impacto em notícias diárias e importantes como sobre a Covid-19, começaram a adotar medidas de detecção otimizadas destes conteúdos. Na minha visão, o problema está em colocar mais tecnologia para combater tecnologias. Neste meio estão os nossos dados, o debate sera frutífero se partisse do olhar da segurança digital e da privacidade.

Como detectar deepfake sem ferramentas algorítmicas

Existem técnicas computacionais avançadas para detectar deepfake. A ciência forense é uma das aliadas neste combate, perícia de mídia que envolve, por exemplo, o exame de vídeos adulterados para encontrar inconsistências fisiológicas. Outra ideia é verificar acústica de um vídeo, correlacionar com a gravação a presença de pessoas no fundo, ou tamanho da cena, enfim existem métodos eficientes utilizados por especialistas, mas quem não é especialista, como pode identificar uma deepfake?

O piscar dos olhos: observe o número e vezes que uma deepfake pisca, como é uma simulação o tempo entre uma piscada e outra é muito maior (delay);

Como a pessoa no vídeo fala: o áudio e o movimento da boca se encaixam? Tem como perceber ao colocar o vídeo numa velocidade mais lenta;

Atenção nas bochechas e na testa: a pele muito lisa ou muito enrugada desproporcionalmente na pele também é sinal de uma possível deepfake.

Preste atenção aos óculos: existe algum brilho? Há muito brilho? O ângulo do brilho muda quando a pessoa se move? As deepfakes falham na iluminação constantemente.

Preste atenção no tamanho e na cor dos lábios: tamanho e a cor correspondem ao resto do rosto da pessoa?

Preste atenção aos pelos faciais ou à falta deles: esses pelos faciais parecem reais?

O deepfake pode adicionar ou remover um bigode, costeletas ou barba. Mas, geralmente, falha em tornar as transformações dos pelos faciais totalmente naturais.

O desafio para reconstruir a confiança

Toda inovação tecnológica gera novas vulnerabilidades, com a ascensão de midias digitais como foco da comunicação em massa, uma tecnologia como deepfake tem consequências graves para a confiabilidade de todos os sistemas de áudio e material audiovisual em geral. Isso dá origem a uma ampla gama de potenciais danos sociais e financeiros, incluindo manipulação dos processos democráticos e dos sistemas financeiro, judiciário e científico.

Deepfakes permitem todos os tipos de fraude, em particular aquelas envolvendo roubo de identidade. Indivíduos — especialmente mulheres — correm maior risco de difamação, intimidação e extorsão, já que as tecnologias deepfake estão conectadas diretamente com conteúdos pornográficos.

Pensando no Brasil, o aumento de conteúdos falsos forçará pessoas que trabalham diretamente com a informação a lidar com uma maior desconfiança por parte da sociedade em relação a todas as informações audiovisuais, o que levará a um confronto de um certo ceticismo. Será necessário desenvolver novas habilidades para construir a imagem confiável diante de uma realidade dominada pela distopia cibernética. Vale salientar que no Brasil, diante da tensão política, quem dissemina a desinformação está buscando resultados imediatos a curto prazo.

Existem perigos ainda desconhecidos, o que dificulta um debate mais aprofundado, mas, com o que já lidamos hoje, é evidente que estamos caminhando para um lugar da não responsabilização de quem cria e dissemina conteúdos falsos neste formato. Com isso, colocamos em perigo direitos essenciais a um cidadão. Ninguém está livre de ter uma deepfake espalhada, já que, nossos dados não estão sob nosso domínio.

Este artigo foi produzido por Nina da Hora, Cientista da Computação e colunista da MIT Technology Review Brasil.